大数据学习笔记 Day01 大数据框架与数据挖掘及分析初探

一、大数据概述

大数据(Big Data)是指无法在一定时间范围内用常规软件工具进行捕捉、管理和处理的数据集合,具有4V特征:

- Volume(大量):数据体量巨大,从TB级别跃升到PB乃至ZB级别。

- Velocity(高速):数据生成和处理速度快,要求实时或近实时分析。

- Variety(多样):数据类型繁多,包括结构化、半结构化和非结构化数据。

- Value(低价值密度):数据价值密度相对较低,需通过挖掘分析提炼高价值信息。

二、主流大数据框架

大数据框架是处理海量数据的软件库和工具的集合,旨在解决存储、计算和分析的难题。

1. Hadoop生态系统

- HDFS(Hadoop Distributed File System):分布式文件系统,提供高吞吐量的数据访问,是Hadoop的存储基石。

- MapReduce:分布式计算编程模型,将任务分解为Map(映射)和Reduce(归约)两个阶段,适合批处理。

- YARN(Yet Another Resource Negotiator):资源管理和作业调度框架,允许多个数据处理引擎(如Spark)在Hadoop集群上运行。

- Hive:基于Hadoop的数据仓库工具,提供类SQL查询(HiveQL),将查询转换为MapReduce任务。

- HBase:分布式、可扩展的NoSQL数据库,适合实时读写大数据集。

2. Spark

- 一个快速、通用的集群计算系统,相比MapReduce,通过内存计算显著提升迭代和交互式查询速度。

- 核心抽象是RDD(Resilient Distributed Dataset),提供Spark SQL、Spark Streaming、MLlib(机器学习库)和GraphX(图计算)等组件。

3. Flink

- 一个流处理和批处理的开源框架,以流处理为核心,将批处理视为有界流。

- 提供高吞吐、低延迟、Exactly-Once语义的流处理能力,适合实时分析场景。

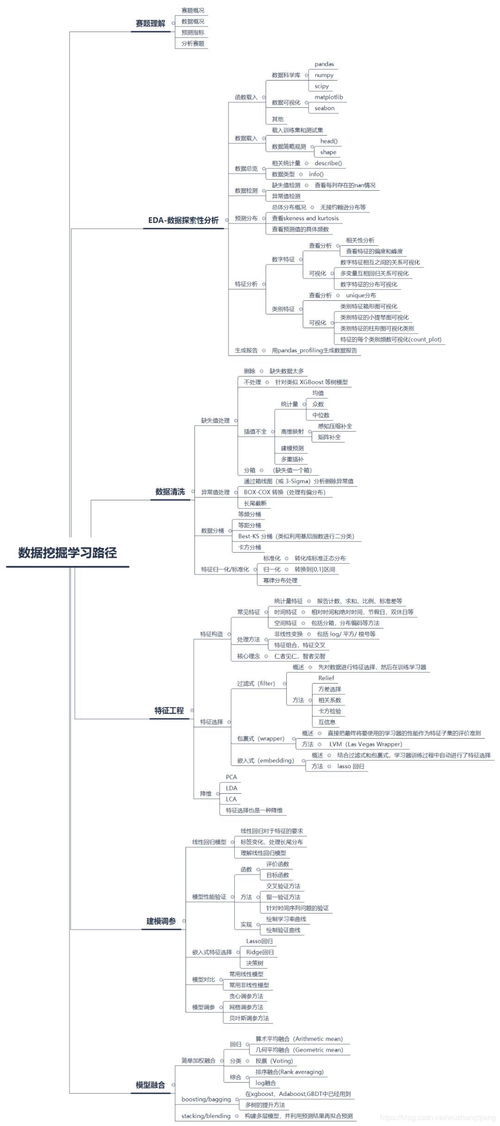

三、数据挖掘及分析

数据挖掘是从大量数据中提取未知的、有价值的模式和知识的过程,是大数据分析的核心。

1. 数据挖掘主要任务

- 分类(Classification):预测离散类别标签,如判断邮件是否为垃圾邮件。

- 聚类(Clustering):将数据分组为相似对象的集合,如客户细分。

- 关联规则学习(Association Rule Learning):发现变量间有趣的关系,如购物篮分析(啤酒与尿布)。

- 回归(Regression):预测连续数值,如房价预测。

- 异常检测(Anomaly Detection):识别异常数据点,如信用卡欺诈检测。

2. 数据分析流程(CRISP-DM)

- 业务理解:明确分析目标和需求。

- 数据理解:收集、探索和描述数据。

- 数据准备:清洗、转换和集成数据,构建分析数据集。

- 建模:选择和应用数据挖掘算法。

- 评估:评估模型是否满足业务目标。

- 部署:将分析结果应用于实际业务。

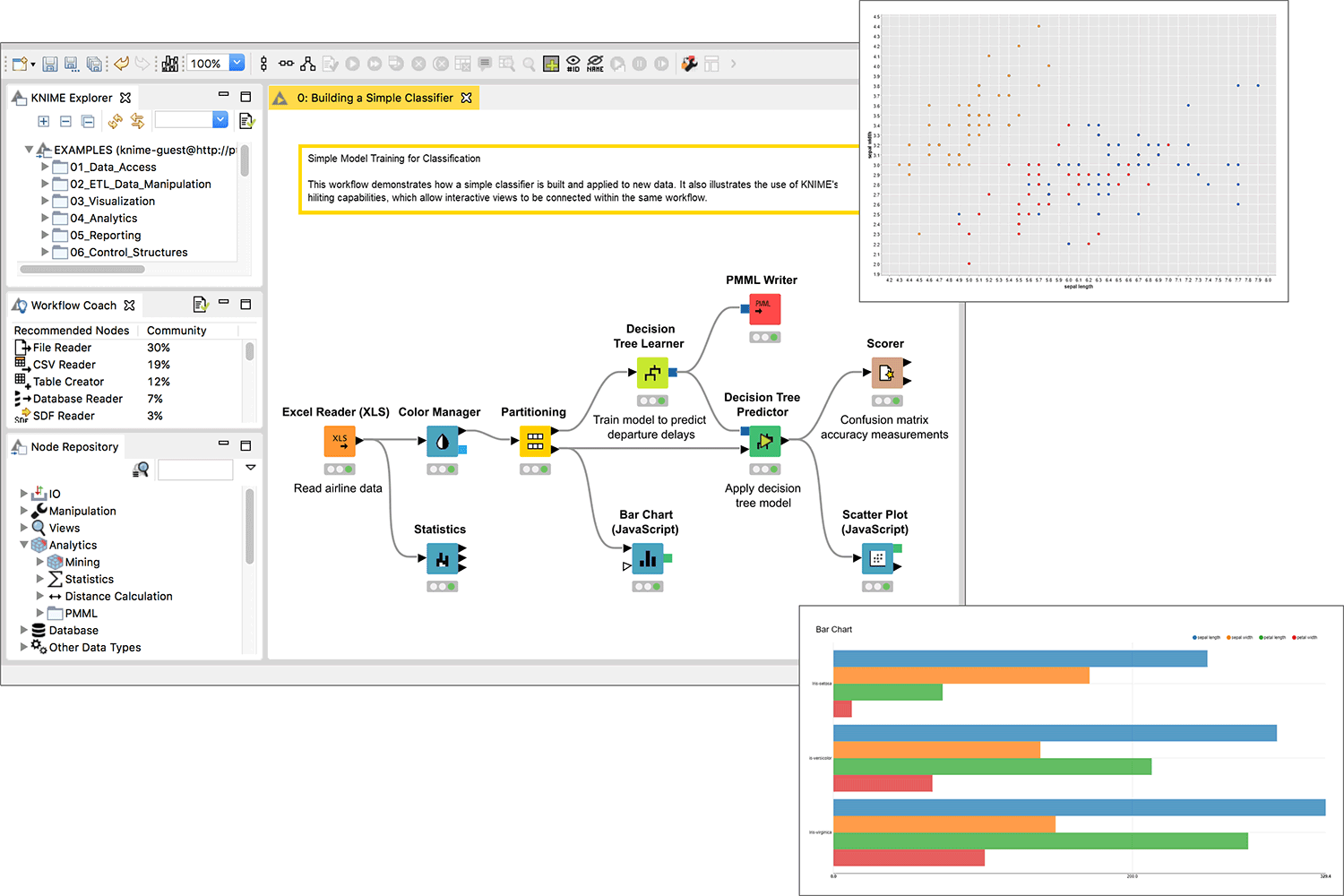

3. 常用工具与技术

- 编程语言:Python(Pandas, Scikit-learn)、R、Scala。

- 数据处理:SQL、Pandas、Spark SQL。

- 机器学习库:Scikit-learn、MLlib(Spark)、TensorFlow/PyTorch(深度学习)。

- 可视化:Matplotlib、Seaborn、Tableau。

四、与展望

Day01的学习聚焦于大数据的基础框架和核心分析概念。理解Hadoop、Spark等框架的定位与特点,是构建大数据处理能力的基础。数据挖掘作为从数据中提取价值的引擎,其任务和流程为后续的深入实践提供了方法论指导。后续学习将深入各框架的实战应用与具体算法的实现。

关键要点回顾:

- 大数据4V特征是理解其挑战的出发点。

- Hadoop适合大规模批处理,Spark以内存计算见长,Flink专精流处理。

- 数据挖掘通过分类、聚类等任务将数据转化为洞察。

- 分析流程(如CRISP-DM)确保项目有序、有效地进行。

如若转载,请注明出处:http://www.appzhiku.com/product/17.html

更新时间:2026-05-30 19:19:43